您的位置:主页 > 公司动态 > 公司新闻 > 公司新闻

GPU,独孤求败?-国际期货

据台媒报道,台积电近期准备最先生产英伟达最新Blackwell平台架构GPU,同时因英伟达的客户需求强劲,故此对台积电的晶圆订单增添25%;并有可能令本周放榜的台积电上调今年盈利预期。

报道引述业界新闻指出,亚马逊、戴尔、谷歌、Meta及微软等都市使用Blackwell架构GPU来确立AI伺服器,令需求超出预期。

英伟达的利好,让人人对人工智能、GPU和AI芯片有了更多的想法,但这能继续连续吗?

01 GPU,销量咋样?

最近,外媒nextplatform还对AI芯片的销售做了展望。

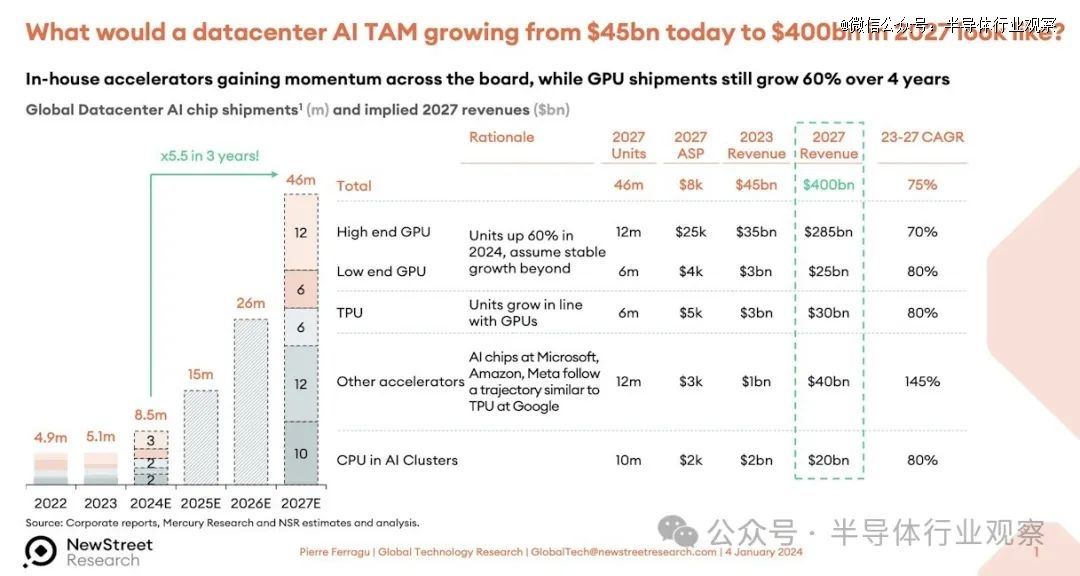

外媒引述AMD CEO苏姿丰的数据示意,到 2023 年,数据中央 AI 加速器的总潜在市场规模约为 300 亿美元,到 2027 年底,该市场将以约 50% 的复合年增进率增进至 1500 亿美元以上。但一年后,随着 GenAI 热潮的兴起,以及 12 月推出“Antares”Instinct MI300 系列 GPU,苏姿丰示意,AMD 预计 2023 年数据中央 AI 加速器市场规模将到达 450 亿美元,到 2027 年,该市场将以跨越 70% 的复合年增进率增进至 4000 亿美元以上。

这仅适用于加速器,而不适用于服务器、交流机、存储和软件。

New Street Research 的 Pierre Ferragu 的团队在科技领域做出了许多精彩的事情,他曾实验剖析这家价值 4000 亿美元的数据中央加速器的潜在市场规模可能会若何,并在 Twitter 上宣布了这一展望:

我们仍然以为这是一个异常大的数字,预计在 TAM 展望期竣事时 AI 服务器、存储和交流机的销售额将到达约 1 万亿美元。

在 2024 年伊始,我们从富国银行股票研究公司董事总司理兼手艺剖析师 Aaron Rakers 那里获得了 GPU 销售展望,并举行了一些电子表格操作。该模子涵盖了 2015 年至 2022 年数据中央的 GPU 销售情形,并估量到 2023 年竣事(展望时尚未竣事)并延伸到 2027 年。富国银行的模子也早于AMD 最近几个月做出的修订展望,AMD 示意 2024 年的 GPU 销售收入将到达 40 亿美元。(我们以为会是 50 亿美元。)

无论若何,富国银行的模子显示,2023 年 GPU 销售额将到达 373 亿美元,整年出货量为 549 万台。出货量险些翻了一番——包罗所有类型的 GPU,而不仅仅是高端 GPU。GPU 收入增进了 3.7 倍。展望 2024 年数据中央 GPU 出货量为 685 万台,增进 24.9%,收入为 487 亿美元,增进 28%。2027 年展望 GPU 出货量为 1351 万台,推动数据中央 GPU 销售额到达 953 亿美元。在该模子中,Nvidia 在 2023 年的收入市场份额为 98%,到 2027 年仅下降到 87%。

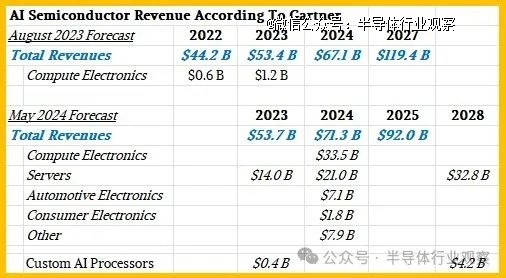

Gartner 和 IDC 最近都宣布了一些关于 AI 半导体销售的数据和展望。

近一年前,Gartner 宣布了一份关于 2022 年 AI 半导体销售的市场研究讲述,并展望了 2023 年和 2027 年的销售情形,几周前,它又宣布了一份修订后的展望讲述,其中展望了 2023 年的销售情形,并展望了 2024 年和 2028 年的销售情形。第二份讲述的市场研究讲述中也包罗一些统计数据,我们将其添加到下表中:

我们假设盘算电子产物包罗小我私人电脑和智能手机,但就连确立这些模子的 Gartner 副总裁兼剖析师 Alan Priestly 也知道,到 2026 年,所有销售的小我私人电脑芯片都将是人工智能小我私人电脑芯片,由于所有条记本电脑和台式机的 CPU 都将包罗某种类型的神经网络处置器。

用于加速服务器的 AI 芯片是我们在The Next Platform上关注的重点,这些芯片的收入(我们假设不包罗附带的 HBM、GDDR 或 DDR 内存的价值)在 2023 年为 140 亿美元,预计到 2024 年将增进 50%,到达 210 亿美元。但预计 2024 年至 2028 年时代服务器 AI 加速器的复合年增进率仅为 12% 左右,销售额将到达 328 亿美元。Priestly 示意,定制 AI 加速器(如 TPU 以及亚马逊网络服务的 Trainium 和 Inferentia 芯片)(仅举两个例子)在 2023 年仅带来了 4 亿美元的收入,到 2028 年也只会带来 42 亿美元的收入。

若是 AI 芯片占盘算引擎价值的一半,而盘算引擎占系统成本的一半,那么这些相对较小的数字加起来可能会带来数据中央 AI 系统相当可观的收入。同样,这取决于 Gartner 在那里划定界线,以及你以为应该若何划定界线。

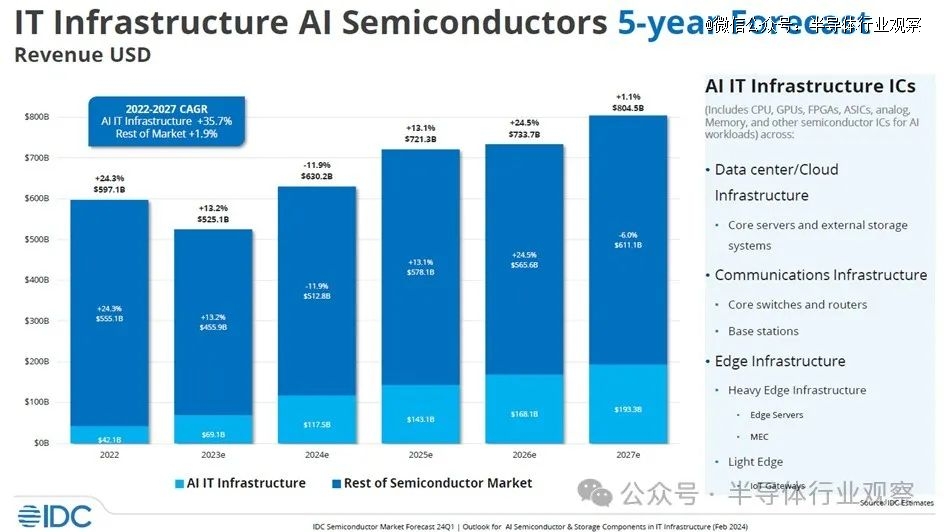

现在,让我们来看看 IDC 若何看待 AI 半导体和 AI 服务器市场。该公司几周前宣布了这张有趣的图表:

在此图表中,IDC 汇总了数据中央和边缘环境中使用的 CPU、GPU、FPGA、定制 ASIC、模拟装备、内存和其他芯片的所有收入。然后,它扣除了盘算、存储、交流机和其他装备的收入,由于这些装备适用于 AI 训练和 AI 推理系统。这不是所有系统的价值,而是系统中的所有芯片的价值;因此它不包罗机箱、电源、冷却、主板、转接卡、机架、系统软件等。如您所见,此图表包罗 2022 年的现实数据,而且仍在估算 2023 年至 2027 年的数据。

在 IDC 的剖析中,半导体市场中的人工智能部门从 2022 年的 421 亿美元增进到 2023 年的 691 亿美元,这意味着 2022 年至 2023 年之间的增进率为 64.1%。今年,IDC 以为人工智能芯片收入——这不仅仅意味着 XPU 的销售,还包罗数据中央和边缘人工智能系统中的所有芯片内容——将增进 70%,到达 1175 亿美元。若是你盘算 2022 年至 2027 年之间的数字,IDC 估量数据中央和人工智能系统中的人工智能芯片内容的物料清单总收入将以 28.9% 的复合年增进率增进,到 2027 年到达 1933 亿美元。

由此看来,GPU似乎照样一致的赢家,但曾在英特尔事情的Raja Koduri最近宣布了一篇文章,剖析了GPU的影响。

02 GPU没有对手?

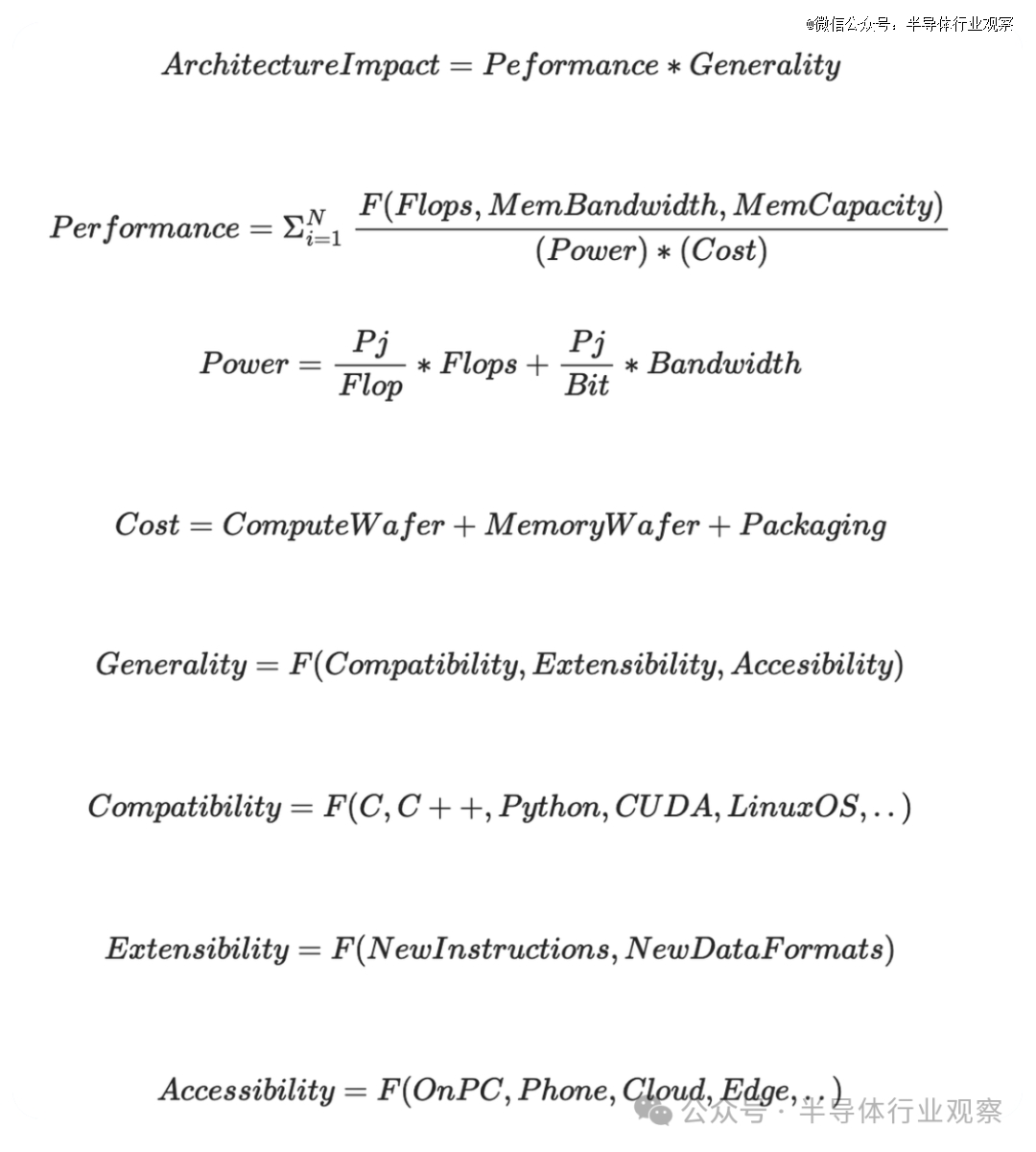

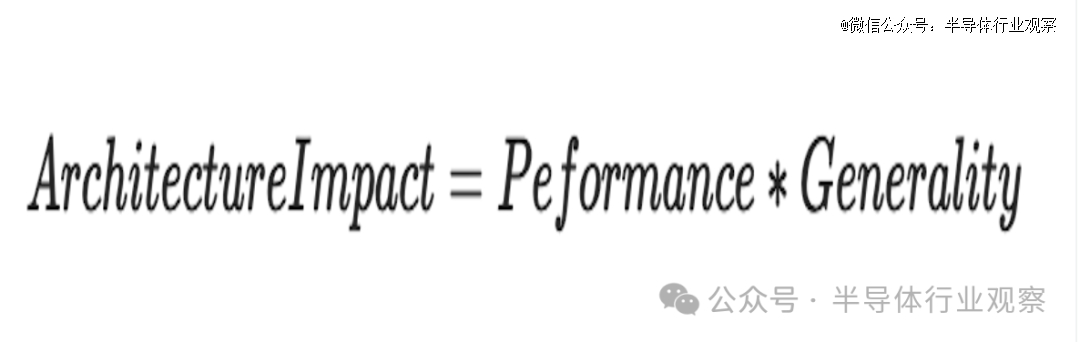

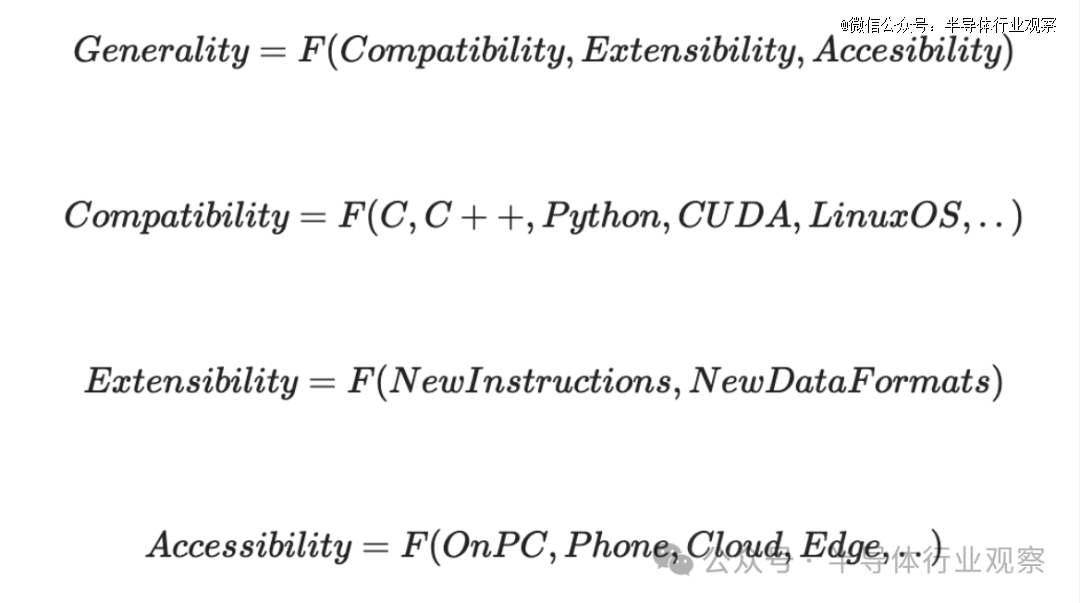

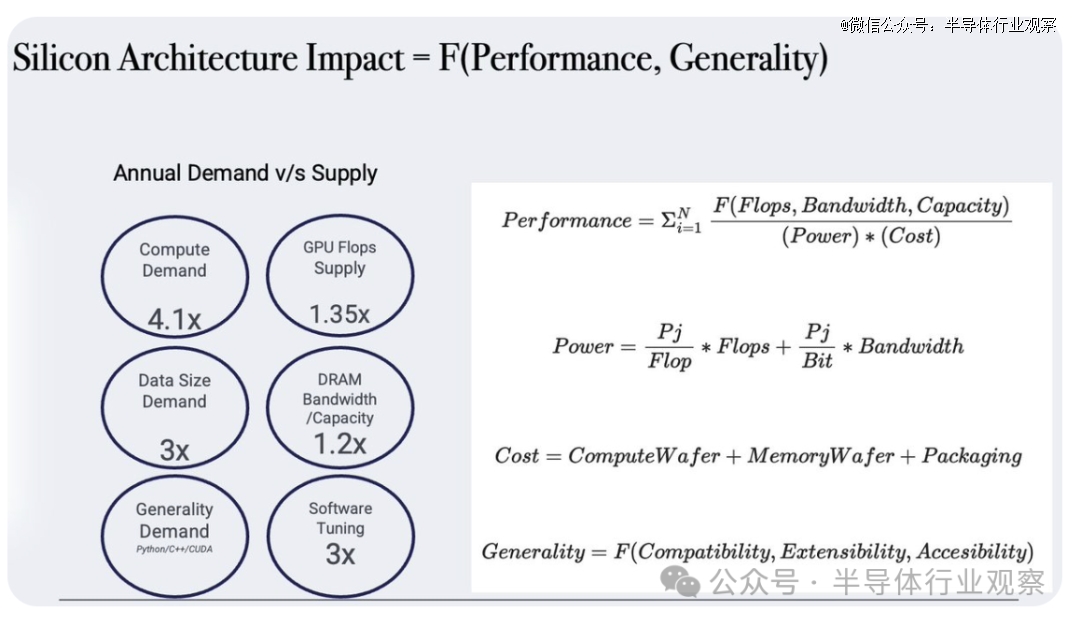

首先,Raja Koduri先分享了一系列的公式。

接下来,他一步步剖析了这些公式:

首先看上面这个公式,Raja Koduri强调,您可以将此等式应用于 CPU 架构,由于这在装备、PC 和云上都取得了乐成。而对于 AI 和其他浮点 带宽麋集型事情负载,GPU 在此等式上得分最高 - 尤其是 CUDA GPU。现在天NVDA的天文估值就是一个很好的方程式形式。

在Raja Koduri看来,有理想的竞争对手应该注重这个等式,并确定你的方式在你所针对的事情负载领域与现有企业的价值。

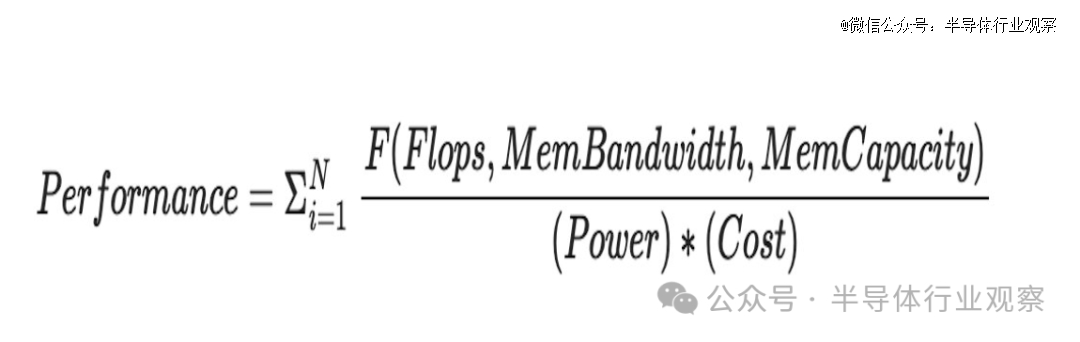

再看上面这个公式。

根据Raja Koduri所说,前面的西格玛(sigma)示意每个事情负载。对于差其余型号/事情负载,浮点运点的比率、带宽和容量要求可能差异。训练与推理是天生差异比率的一个例子。

Raja Koduri同时强调,我们不要遗忘,在推理和训练循环之外,另有加速盘算的需求 例如:图像和语音处置以及众所周知的并行数据剖析和模拟算法。您的通用性会影响“N”的巨细。此 N 对于 CUDA GPU 来说意义重大。对于 CPU 来说,N 甚至更大,但随后等式的其余部离最先施展作用,它们的性能弱点占主导职位。

分子有 3 个参数 Flops、Bandwidth 和 Capacity。

Raja Koduri重申,Flop 需要通过宽度 (64,32,19, 16,8,4..) 和类型 (float, int..) 举行限制,事情负载可以夹杂使用这些。同样,带宽和容量也具有许多条理结构 - 寄存器、L1、L2、HBM、NVlink、以太网、NVME......

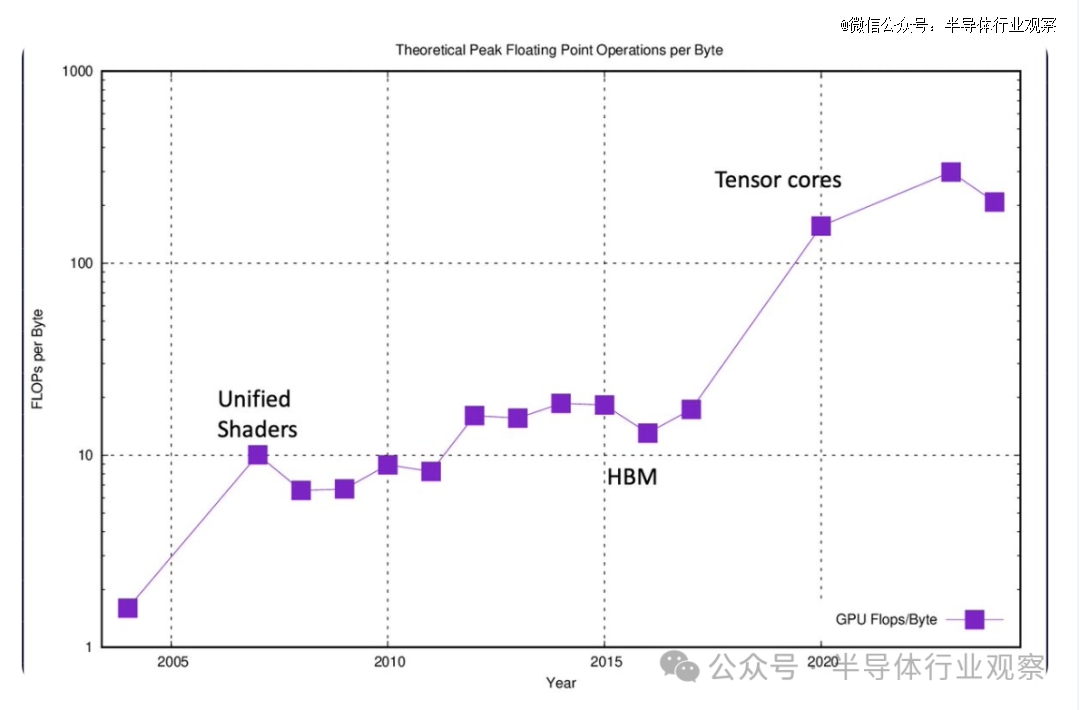

Raja Koduri在文章中还对现代 GPU 性能优化战略的简要先容。

他示意,当我们首次在 GPU 中引入浮点可编程着色器时,浮点运算与 DRAM 带宽的比率为 1:1。在最新的 GPU 上,对于 16 位甚至更高、精度更低的花样,该局限跨越 300:1。现在,对于更靠近盘算的内存(如寄存器、L1、L2 等)来说,这个比率变得更好。若是你研究一下最近关于转换器的大多数优异的GPU优化事情,它归结为最小化这个比例。使用关闭内存层的次数越多越好。

在Raja Koduri看来,其他战略包罗行使未充实行使的浮点点数以异步(Async)方式运行下一个 ALU 受限阶段。运气和技巧在寻找漂亮的“overlappable”代码块方面起着主要作用,这些代码块不会损坏相互的缓存。

不外Raja Koduri强调,异步不适合怯弱的人。您可以对代码举行的每一个百分点的flop-utilization改善都可能节约数十亿美元。

其他常见问题包罗——为什么 CPU 职员不投入更多的 FLOPS 和 BANDWIDTH 并赢得 AI 战争?是否存在基本的架构限制?

Raja Koduri示意,关于这个问题的简朴物理学谜底是“否”。 然则,要将更多带宽引入 CPU,需要对 CPU 结构基础设施举行多次升级(和妥协)。一样平常来说,折衷方案是延迟。若是有人向您展示他们可以以更低的延迟、更低的功耗和成本提供更高的带宽。那么尼可站起来,加入他们的宗教。

CPU 设计职员倾向于优先思量延迟而不是带宽,由于通常凭证延迟来判断他们的事情负载集。像英特尔 Sapphire Rapids HBM 这样的产物提供了很好的带宽提升,但不足以挑战 GPU。

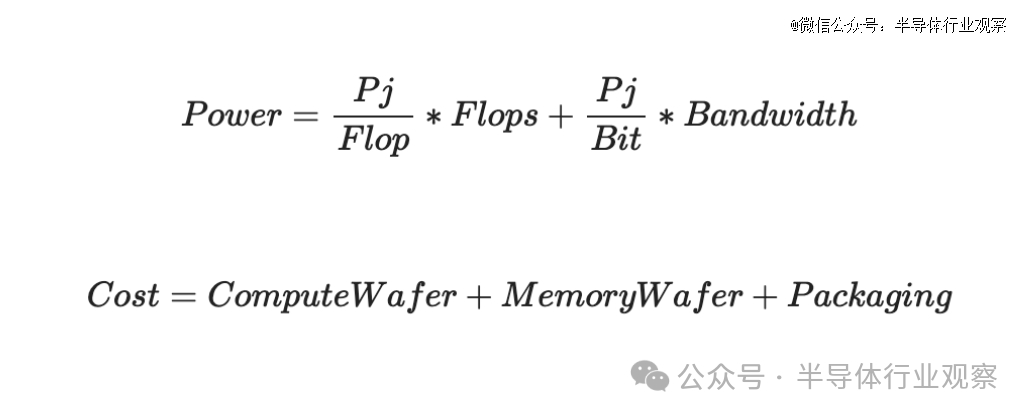

接下来看下面与功耗和成本有关的公式:

首先看功耗方面,从图中可以看到,Pj/Flop 在主流半导体工艺方面并没有显着改善。你*可以玩的游戏是flop的界说,我们把它从64降低到4..现在可能是1.5。今天 FP16 的 pj/flop 在 0.5-0.7 的局限内。

peta-flop GPU 的快速盘算,10^15 * (0.7*10^-12) = 700 瓦。带宽的功率盘算起来有点棘手,而且可能会踩到供应商的一些专有信息,在这里就不深入剖析了。

人工智能:半个世纪的思想运动

Pj/Bit 是我看到架构师可以行使的主要 (10 倍) 时机的地方。我以为本十年的下半年将看到许多有趣的实验,包罗围绕近内存、内存盘算、共封装光子学等的行动。

再看成本方面,每个节点的盘算晶圆成本都对照昂贵,内存职员也在行使人工智能的需求。

Raja Koduri示意,在10 年前,他不会将“封装”作为主要成本要素,但现在这是一件大事。除了先进的封装外,与热能和电力运送相关的成本也大幅上升。部门成本在物理上是合理的 - 但其中很大一部门是由生态系统驱动的,试图在英伟达贪心的利润率下支持他们的利润率。

在Raja Koduri看来,使用替换封装方式可以显著(2-3 倍)降低成本,阻止昂贵的有源中介层 2.5D/3D 堆叠。但现在尚不清晰它们是否会很快成为消费者的利益,直到人工智能需求与供应到达更合理的水平。

最后,看看公式的其他部门。

首先看Compatibility(兼容性),这里涉及有趣的 GPU 历史。

Raja Koduri先容,在2002 年,GPU行业引入了 24 位浮点的可编程着色器(与特殊的 ATI R300 一起),并引入了高级着色语言(HLSL、GLSL、Cg),这些语言主要是基于 C 的语言,具有要害约束和扩展。这对游戏引擎开发职员来说是一个福音,我们见证了 2002 年至 2012 年间实时渲染的指数级提高。然则对于熟悉本机 C/C 的通用程序员来说,这些语言很尴尬。因此,GPU 主要局限于游戏开发者。

到了2005 年,高性能 IEEE FP32 的推出引发了 GPGPU 的热潮——这要归功于 Mike Houston、Ian Buck 等斯坦福大学校友,他们推动了早期的 GPGPU 语言,如 Brook 和 ATI 提出了一种称为 CTM(Close to the metal)的汇编级抽象。虽然这些起劲对于演示来说很棒,但它们并没有越过“兼容性”的门槛,在学术研究之外获得任何严肃的兴趣。

而CUDA(以及精彩的 Nvidia G80 架构)是*个将“指针”(pointers)引入 GPU 语言的,并为 C 程序员提供了更恬静的抽象来使用 GPU。正如他们所说,休息是历史。指针和虚拟内存支持也是将 GPU 作为一流的协处置器集成到所有操作系统中的要害。这是硬件加速器设计经常忽视的一个方面,这使得为这些加速器编写驱动程序成为软件工程师的噩梦。

Raja Koduri以为,CUDA的另一个方面没有获得普遍的赞赏。如她所说,CUDA 编程模子是 NVIDIA GPU HW 执行模子的真正抽象。硬件和软件是配合设计的,并系在HIP(原文:The hardware and software are co-designed and tied at the hip)。虽然许多像 SPMD 这样的 CUDA 模子都具有可移植性(OpenCL、Sycl、OpenMP、HIP-RocM...),但实现性能可移植性险些是不能能的(除非您的架构是准确复制的 CUDA GPU 执行模子)。鉴于涉足 GPU 的程序员将加速作为主要目的,无法辅助您高效地实现优越性能的语言和工具无法获得 CUDA 的吸引力。

“CUDA 程序员与 Python/Pytorch 程序员之间有一个有趣的对比 - 但这是另一个时间的线程”,Raja Koduri说。

Raja Koduri认可,CUDA 改善了 GPU 通用性以吸引 C/C 程序员。

“对于降生于python时代的下一代硬件架构师来说,下一个乐成的软硬件协同设计会是什么?”Raja Koduri接着说。

来到Extensibility(扩展)方面。

Raja Koduri示意,GPU 架构以增量方式扩展了许多次。我发现令人惊讶的是,我们仍然可以在现代 GPU 上运行 20 年前构建的游戏二进制文件。虽然在微观架构方面取得了许多提高,但宏观层面看起来仍然是一样的。我们添加了许多新的数据类型、花样、指令扩展,同时保持兼容性。甚至在保留 SPMD 模子的同时添加了张量单元。这种可扩展性使 GPU 能够快速顺应新的事情负载趋势。

一些专家指斥 GPU 对于纯张量数学来说异常“低效”——提出并构建了与 GPU 架构不兼容的替换架构。然而,我们仍在守候这些架构之一发生有意义的影响。

再看Accessibility(可及性)方面。

在Raja Koduri看来,这是 GPU 最被低估的优势。您的架构需要可供所有区域的宽大开发职员接见。在这方面,游戏GPU对Nvidia来说是一个伟大的福音。我们经常看到天下各地的年轻大学生通过条记本电脑或台式机中的 3060 等中端游戏 GPU 最先首次体验 GPU 加速。Nvidia 在使其开发职员 SDK 可在装有 Windows 和 Linux 的 PC 上接见方面做得异常精彩。

但Raja Koduri以为,对盘算和带宽的需求每年增进 3-4 倍。凭证这里列出的*个原则,CUDA GPU 硬件将被中止。*的问题是“谁”和“何时”?

在回覆读者的问题时,Raja Koduri示意,Python 和内存是他以为CUDA GPU将会被推翻的底气。

03 软件将成为新焦点

而在AMD最近收购 Silo AI之后,有剖析师以为,软件已成为焦点,人工智能芯片战场发生转变。剖析师以为,这一战略转变正在重新界说人工智能竞赛,其中软件专业知识变得与硬件实力一样主要。

剖析师示意,AMD 最近收购了欧洲*的私人 AI 实验室 Silo AI,这体现了这一趋势。Silo AI 在开发和部署 AI 模子方面拥有厚实的履历,尤其是大型语言模子(LLM),这是 AMD 关注的一个要害领域。

此次收购不仅增强了 AMD 的 AI 软件能力,也增强了其在欧洲市场的职位,Silo AI 在欧洲市场以开发文化相关的 AI 解决方案而享有盛誉。

Counterpoint Research 合资人兼团结首创人 Neil Shah 示意:“Silo AI 填补了 AMD 从软件工具(Silo OS)到服务(MLOps)的主要能力空缺,辅助定制主权和开源 LLM,同时扩大其在主要欧洲市场的影响力。”

AMD 此前已收购 Mipsology 和 Nod.ai,进一步牢固了其致力于打造壮大 AI 软件生态系统的答应。Mipsology 在 AI 模子优化和编译器手艺方面的专业知识,加上 Nod.ai 对开源 AI 软件开发的孝顺,为 AMD 提供了一套周全的工具和专业知识,以加速其 AI 战略。

Cyber media Research 行业研究组副总裁 Prabhu Ram 示意:“这些战略行动增强了 AMD 为追求跨平台天真性和互操作性的企业提供定制开源解决方案的能力。通过整合 Silo AI 的功效,AMD 旨在提供一套周全的套件,用于开发、部署和治理 AI 系统,普遍知足差异客户的需求。这相符 AMD 作为可接见和开放 AI 解决方案提供商不停生长的市园职位,充实行使行业对开放性和互操作性的趋势。”

这种向软件的战略转变并不局限于AMD。其他芯片巨头如Nvidia和Intel也在起劲投资软件公司并开发自己的软件客栈。

Shah 示意:“若是你看看 Nvidia 的乐成,你会发现它不是由硅片驱动的,而是由其在盘算平台上提供的软件(CUDA)和服务(带有 MLOps、TAO 等的 NGC)驱动的。”“AMD 意识到了这一点,并一直在投资构建软件(ROCm、Ryzen Aim 等)和服务(Vitis)功效,为客户提供端到端解决方案,以加速 AI 解决方案的开发和部署。”

Nvidia 最近收购了 Run:ai 和 Shoreline.io,这两家公司均专注于 AI 事情负载治理和基础设施优化,这也凸显了软件在*限度提高 AI 系统性能和效率方面的主要性。

但这并不意味着芯片制造商会遵照类似的轨迹来实现目的。Techinsights 的半导体剖析师 Manish Rawat 指出,在很洪水平上,Nvidia 的 AI 生态系统是通过专有手艺和壮大的开发者社区确立起来的,这使其在 AI 驱动的行业中站稳了脚跟。

Rawat 弥补道:“AMD 与 Silo AI 的互助解释,AMD 将集中精神扩展其在 AI 软件方面的能力,在不停生长的 AI 领域与 Nvidia 睁开竞争。”

另一个相关的例子是英特尔收购实时连续优化软件提供商 Granulate Cloud Solutions。Granulate 辅助云和数据中央客户优化盘算事情负载性能,同时降低基础设施和云用度。

芯片和软件专业知识的融合不仅是为了遇上竞争对手,还为了推悦耳工智能领域的创新和差异化。

软件在优化特定硬件架构的 AI 模子、提高性能和降低成本方面施展着至关主要的作用。最终,软件可以决议谁主宰 AI 芯片市场。

Amalgam Insights 首席执行官兼首席剖析师 Hyoun Park 示意:“从更大角度来看,AMD 显然正在与 NVIDIA 争取 AI 领域的霸主职位。归根结底,这不仅仅是谁制造出更好的硬件的问题,而是谁能够真正支持部署高性能、治理优越且易于耐久支持的企业级解决方案。只管 Lisa Su 和 Jensen Huang 都是科技界最伶俐的高管之一,但只有其中一人能够最终赢得这场战争,成为 AI 硬件市场的*。”

软件专业知识与芯片公司产物的整合正在催生全栈 AI 解决方案。这些解决方案涵盖从硬件加速器和软件框架到开发工具和服务的所有内容。

通过提供周全的 AI 功效,芯片制造商可以知足更普遍的客户和用例,从基于云的 AI 服务到边缘 AI 应用。

例如,Shah 示意,Silo AI 首先带来了履历厚实的人才库,尤其是致力于优化 AI 模子、量身定制的 LLM 等。Silo AI 的 SIloOS 是 AMD 产物的一个异常壮大的弥补,允许其客户行使先进的工具和模块化软件组件来定制相符其需求的 AI 解决方案。这对 AMD 来说是一个伟大的差距。

Shah 弥补道:“第三,Silo AI 还引入了 MLOps 功效,这对于平台介入者来说是一项要害功效,可以辅助其企业客户以可扩展的方式部署、改善和运营 AI 模子。这将辅助 AMD 在软件和硅片基础设施之上开发服务层。”

芯片制造商从单纯提供硬件转向提供软件工具包和服务,这对企业科技公司发生了重大影响。

Shah 强调,这些生长对于企业和人工智能开发职员微调他们的人工智能模子以增强特定芯片上的性能至关主要,适用于训练和推理阶段。

这一提高不仅加速了产物的上市时间,而且还辅助互助同伴(无论是超大规模企业照样治理内部部署基础设施)通过改善能源使用和优化代码来提高运营效率并降低总拥有成本 (TCO)。

“此外,对于芯片制造商来说,这是一种很好的方式,可以将这些开发职员锁定在他们的平台和生态系统中,并在其基础上通过软件工具包和服务赚钱。这还可以带来经常性收入,芯片制造商可以再投资并提高利润,投资者喜欢这种模式,”Shah 说。

随着人工智能竞赛的不停生长,对软件的关注必将加剧。芯片制造商将继续投资软件公司,开发自己的软件客栈,并与更普遍的人工智能社区互助,打造一个充满活力和创新的人工智能生态系统。

人工智能的未来不仅在于更快的芯片,还在于更智能的软件,它可以释放人工智能的所有潜力并改变我们的生涯和事情方式。

综上所述,人人以为GPU主导的市场,会被推翻吗?